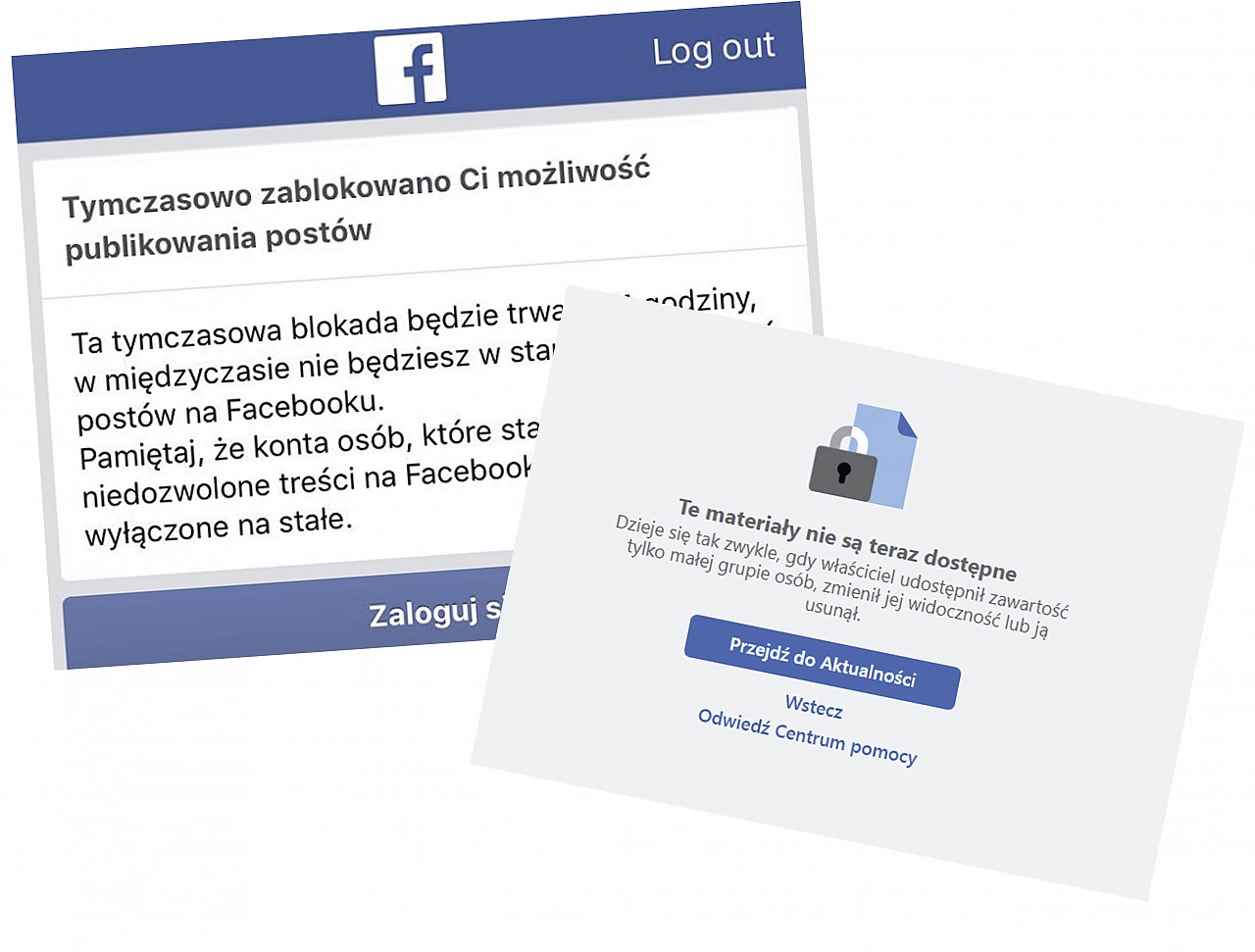

Nieoczekiwana blokada konta w mediach społecznościowych to największy koszmar, jaki spędza sen z powiek internetowych twórców. Lata pracy i nakładów finansowych zainwestowanych w budowanie wielkich społeczności mogą zniknąć w jednej chwili i bez żadnego powodu. Takie sytuacje dotknęły profil mistrzowie.org, czy też blogerce modowej Harel, którzy na pewien czas stracili dostęp do swych kont. Właściciele profilu kartypodarunkowe.online mieli mniej szczęścia, bo Meta aż dwukrotnie całkowicie usuwała ich profil, przez co musieli od początku go zakładać. Co jednak gorsze nikt z nich nie poznał tajemnicy, co kryło się zablokowaniem konta, a potem jego odblokowaniem lub usunięciem. Wnioski wszyscy mają takie same – nie wolno opierać swojego biznesu tylko na social mediach.

Pod koniec września admin fanpage’a Mistrzowie.org, Mariusz Składanowski, zaczął otrzymywać informację od znajomych, że prowadzona przez niego strona nie działa. Po zalogowaniu się na profil zobaczył, że konto zostało zablokowana za “naruszenie standardów Facebooka”. Po zagłębieniu się w zgłoszenie, jako konkretny powód znalazł informację, że blokada została spowodowana “podszywaniem się pod inne osoby lub markę”. Nie za bardzo dowierzał, że strona zbierająca memy będące fragmentami komentarzy i cytatami z innych stron, może ukraść tożsamość innej marce czy osobie, więc szybko zgłosił blokadę do weryfikacji. Chwilę później otrzymał automatyczną odpowiedź, że zgłoszenie zostanie rozpatrzone w ciągu kilku dni przez "technologię lub weryfikatora". Nie musiał jednak zbyt długo czekać, gdyż w ciągu kilku chwil podanie zostało rozpatrzone przez system… negatywnie, a strona zablokowana. “Brak mi słów. Żyjemy w świecie, w którym algorytmy decydują o być albo nie być całych kawałków internetu, bez żadnego rozsądnego uzasadnienia, bez możliwości odwołania, za to zgodnie z zasadami bezpieczeństwa" - napisał na swoim profilu Mariusz Składanowski, gdy w wyniku decyzji algorytmu stracił społeczność o wielkości niemal 370 tysięcy osób, budowaną od 2010 roku.

Do sytuacji popularnego fanpage’a szybko odnieśli się inni twórcy i dziennikarze. Sylwia Czubkowska, współautorka podcastu Techstories w TOK FM, na swoim profilu na platformie X skomentowała, że działanie jest z jednej strony przykładem “prywatnej cenzury, ale także underblokingu, a z drugiej niewystarczającej walki z dezinformacją, scamem i po prostu przestępstwami, odkąd Facebook w 2010 r. wprowadził algorytmy”.

Na szczęście twórca Mistrzowie.org nie zaprzestał na odwołaniu od decyzji algorytmu w ramach “oficjalnej drogi administracyjnej”, ale zaczął szukać rozwiązania problemu poza formalnymi kanałami.